Довіра до AI — це не лише відчуття. Це інженерна задача.

Усі статті серії доступні до прочитання безкоштовно у моєму блозі: англійською та українською.

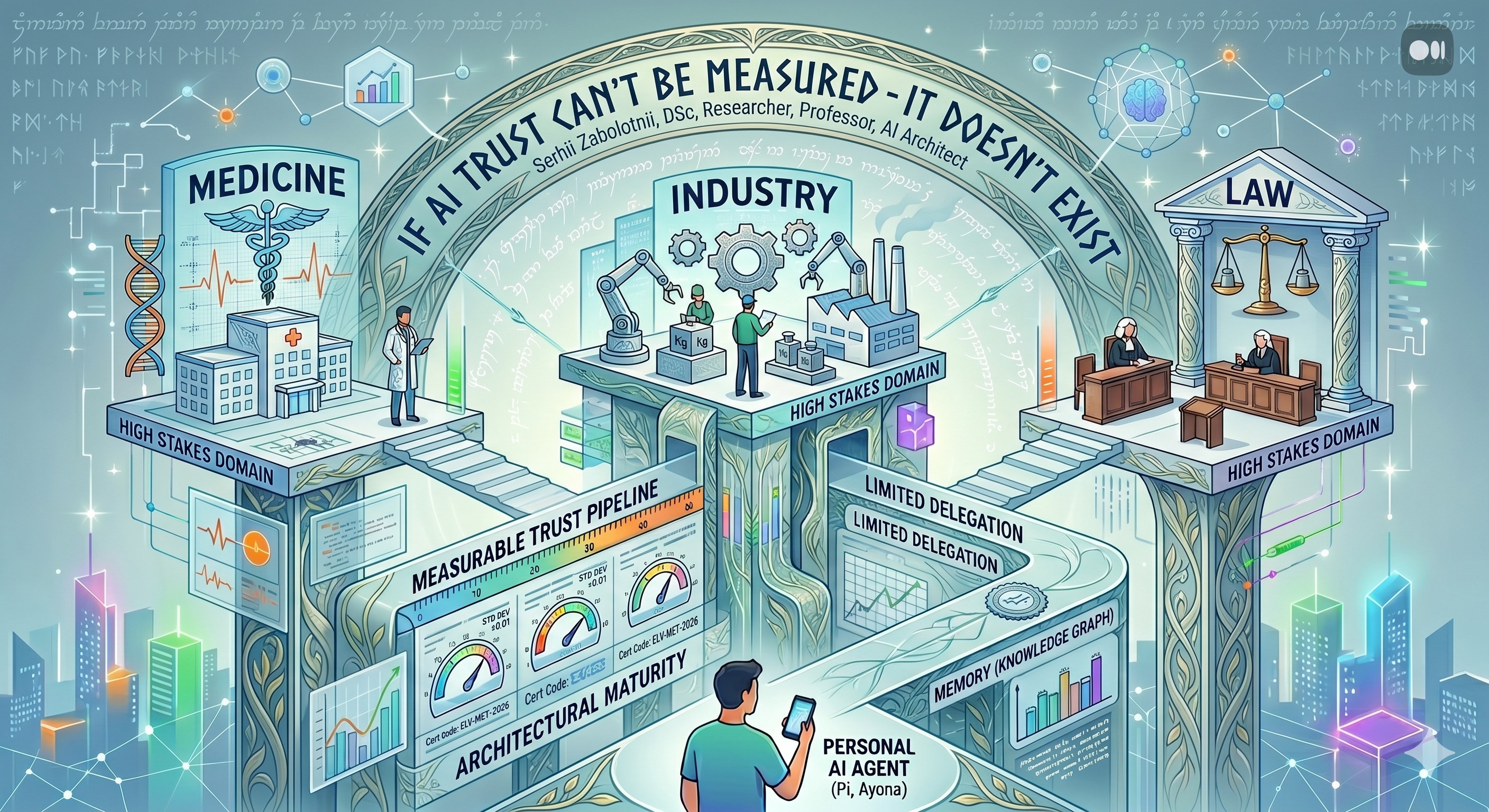

Майбутнє агентних систем визначатиметься не потужністю моделі, а архітектурою довіри.

Як допис Earendil став тригером для цього тексту

Нещодавно я натрапив на блог нової компанії Earendil — команди, що придбала Pi, мінімальний і широко використовуваний агент для програмування з відкритим кодом, написаний Маріо Цехнером (Mario Zechner). Pi — чудовий приклад майстерності й смаку в сучасному програмному забезпеченні: відданість відкритості, розширюваності та якості коду. Паралельно з придбанням Маріо Цехнер став ключовим учасником і членом команди Earendil — і це багато говорить про цінності компанії.

Але мене вразила не стільки технологічна амбіція, скільки філософія: довіра до AI має бути заслуженою, а не прийнятою на віру. Система не отримує доступ до всього одразу — вона доводить свою надійність поступово, через демонстровану відповідальність. Відкрита архітектура замість чорної скриньки. Метрологічна вимірюваність замість декларативної надійності.

Ця думка зачепила мене, бо я впізнав у ній те, що сам формулював останні місяці. У серії статей про систему Ayona/OpenClaw я описував, як архітектура — пам’ять, граф знань, маршрутизація, обмежена делегація, верифікація — перетворює AI-асистента не лише на робочий інструмент, а можливо і дещо більше - на майбутнього колегу. У спеціалізованій роботі для Special Issue on A Measure of Trust in Healthcare (перебуває на етапі рецензування) я разом із співавторами обґрунтовував, що довіра до клінічного AI має бути не враженням від моделі, а вимірюваною архітектурною властивістю системи.

І ось Earendil формулює по суті те саме — але з іншого боку. Не від інженерії, а від культури взаємодії. Не від метрології, а від етики присутності. Цей резонанс і став тригером для тексту, який ви зараз читаєте: рефлексії на перетині чужого бачення і власного досвіду.

Pi як культурний маркер: від експертної машини до когнітивної присутності

“Pi написаний Маріо Цехнером, і на відміну від Пітера Steinberger (автора OpenClaw)↩, який прагне до «наукової фантастики з відтінком божевілля», Маріо дуже приземлений. Попри відмінності в підході, і OpenClaw, і Pi сповідують одну й ту саму ідею: LLM дуже добре пишуть і запускають код — тож прийми це. У певному сенсі я думаю, що це не випадковість, бо саме Пітер підсадив і мене, і Маріо на цю ідею — і на агентів минулого року.” — Armin Ronacher

Образ Pi набув значення не завдяки показникам продуктивності, а тому, що представляв іншу модель взаємодії. У центрі — не потуга чи демонстрація експертності, а м’якість, уважність, підтримка і делікатний супровід. Pi — це культурний маркер переходу від уявлення про AI як про експертну машину до уявлення про нього як про форму тривалої когнітивної присутності.

Earendil підхоплює цю логіку і загострює її. У їхньому баченні штучний інтелект — це не технічна послуга, а проблема форми взаємодії. Яким має бути цифровий співрозмовник, щоб його присутність не виснажувала, не підміняла людську волю і не створювала ілюзії безпомилкової компетентності? Довіра тут — не безкритична віра в коректність відповіді, а властивість стосунку між людиною і системою.

Звідси важливий висновок: афективно м’який інтерфейс сам по собі не гарантує надійності. Турботлива інтонація може співіснувати з непрозорою логікою. Отже, наступний етап після Pi пов’язаний не зі збільшенням комунікативної привабливості агента, а з досягненням його архітектурної зрілості.

Ayona: від уявного експерименту до реальної архітектури

Щоб зрозуміти цю зрілість, корисно мислити через образ Айони (Аї) — не просто як ще одного асистента, а як фігуру довіреного цифрового напарника. Такий агент уже не існує в режимі випадкової відповіді. Він включений у тривалу взаємодію, знає стиль мислення користувача, підтримує пам’ять про попередні рішення, допомагає тримати стратегічну лінію — і при цьому не повинен розчинятись у спокусі всезнання.

У серії статей про Ayona/OpenClaw я описую, як цей образ перетворюється на конкретну архітектуру: семирівнева пам’ять, граф знань як топологія рішень, гібридний пошук, обмежена делегація з контрактами, маршрутизація моделей за типом складності. Ая — це не лише уявний експеримент. Це робоча система, через яку видно головну проблему нового покоління агентів.

І ця проблема — не «розумність» у вузькому сенсі. Справжнє питання: як поєднати когнітивну близькість із дисципліною меж. Гарний агент має бути достатньо включеним, щоб бути корисним, але достатньо стриманим, щоб не захоплювати простір людського рішення. Агент, гідний довіри, не може будуватись лише як сильна мовна модель — його потрібно будувати як систему з різними рівнями перевірки, обмеження і людського втручання.

Коли ціна помилки змінює все

Перехід від персонального агента до критичних сфер таких як медицина, промисловість і юриспруденція — це не масштабування. Високоризикові галузі змінюють саму природу вимог. У персональному режимі шкода від помилки обмежена і виправна. В медицині, на виробництві чи в праві помилка стає практичною і моральною подією. Тому агент, який входить у ці сфери, повинен змінити свою архітектурну форму: чіткі контракти даних, явні межі дій, механізми ескалації, журналювання і місця, де людина залишається незамінною частиною системи.

Медицина: сила стриманості

У медицині агентна система не повинна імітувати всемогутнього клініциста. Її цінність — допомогти організувати складність, вчасно виявити ризик, зіставити закономірності, структурувати дані для лікаря. Довіра тут будується не на харизмі відповіді, а на стриманості системи: здатності сигналізувати межі своєї придатності, показувати джерела, відокремлювати спостереження від висновку і залишати лікареві центральну роль у судженні. Саме це ми і намагаємося обґрунтувати в IEEE manuscript, формулюючи ідею вимірюваної довіри (measurable trust): довіра має бути не враженням, а інженерно спроєктованою і вимірюваною характеристикою.

Виробнича сфера: вбудованість у екологію відповідальності

У виробничих середовищах, де переплітаються сенсори, регламенти, аварійні сценарії та людські ролі, агент повинен бути координатором дисциплінованої дії. Його цінність — у здатності поєднати різнорідні сигнали, підтримати оператора, не допустити зайвої тривоги і водночас не приховати ризику. Система повинна бути спроєктована так, щоб її хиби були локалізованими і помітними. Агент тут корисний не тоді, коли він «найрозумніший у кімнаті», а тоді, коли він правильно вбудований у вже існуючу екологію відповідальності.

Право: де закінчується допомога і починається влада

Юриспруденція особливо чутлива до агентних систем, бо тут мова завжди вплетена у владу. Коли AI працює з правовими текстами і прецедентами, кожне формулювання може мати наслідки для людських доль і легітимності рішення. Головне питання — не точність, а допустимість ролі. Де агент ще структурує матеріал, а де вже непомітно програмує результат? Юридичний агент має не приховувати свою допоміжну природу, а постійно її підкреслювати. Його завдання — допомогти інституції краще мислити власними словами, а не говорити замість неї.

Чому майбутнє належить не моделі, а архітектурі

У всіх цих сферах (і не лише в цих) проступає спільна істина: доля агентних систем визначатиметься не рівнем окремої моделі, а архітектурою, у яку ця модель поміщена. Майбутнє належить не універсальному штучному співрозмовнику, а композиціям, де інтелект поєднується з обмеженням, пам’ять — з дисципліною, а допомога — з перевіркою.

Мій власний досвід це підтверджує. У AI системі надійність з’являється не від «розумнішої моделі», а від конвеєра довіри: гібридний пошук замість наївного семантичного, обмежений доступ замість відкритого, оболонка делегування із трьома термінальними станами замість голого запиту, цикл верифікації з автоматичною перевіркою. Агент майбутнього можливо буде більше схожий не на геніального імпровізатора, а на добре організованого учасника складної людської практики. Його сила — не свобода від обмежень, а здатність діяти всередині правильних меж.

Замість висновків

Earendil формулює це з боку культури присутності. Я пропоную підходити до цього з боку інженерії довіри. Але висновок спільний: головне завдання наступного етапу агентного ШІ полягає не в нарощуванні інтелектуальної потужності, а у формуванні таких структур цифрового напарництва, в яких довіра буде забезпечуватися не стилістичною переконливістю, а організацією самої дії.

Якщо довіру не можна виміряти — її не можна спроєктувати. Якщо її не можна спроєктувати — її не можна гарантувати. А без гарантії довіри агент залишається лише красивою демонстрацією.

Це продовження серії статей про архітектуру Ayona/OpenClaw. Попередні частини:

- Only a Powerful LLM Won’t Save You

- Trust Is a Pipeline

- When a Single Agent Hits Its Limits

- Ayona/OpenClaw vs Milla MemPalace

- I Finally Open-Sourced Ayona/OpenClaw

- Memory Has Architecture Too

Сергій Заболотній — DSc, NLP/LLM Researcher, Professor, AI Systems Architect. szabolotnii.site